對於想深入瞭解線性迴歸的童鞋,這裡給出一個完整的例子,詳細學完這個例子,對用scikit-learn來執行線性迴歸,評估模型不會有什麼問題了。

1. 獲取資料,定義問題

沒有資料,當然沒法研究機器學習啦。:) 這裡我們用UCI大學公開的機器學習資料來跑線性迴歸。

資料的介紹在這: http://archive.ics.uci.edu/ml/datasets/Combined+Cycle+Power+Plant

資料的下載地址在這: http://archive.ics.uci.edu/ml/machine-learning-databases/00294/

裡面是一個迴圈發電場的資料,共有9568個樣本資料,每個資料有5列,分別是:AT(溫度), V(壓力), AP(溼度), RH(壓強), PE(輸出電力)。我們不用糾結於每項具體的意思。

我們的問題是得到一個線性的關係,對應PE是樣本輸出,而AT/V/AP/RH這4個是樣本特徵, 機器學習的目的就是得到一個線性迴歸模型,即:

\(PE = \theta_0 + \theta_1*AT + \theta_2*V + \theta_3*AP + \theta_4*RH\)

而需要學習的,就是\(\theta_0, \theta_1, \theta_2, \theta_3, \theta_4\)這5個引數。

2. 整理資料

下載後的資料可以發現是一個壓縮檔案,解壓後可以看到裡面有一個xlsx檔案,我們先用excel把它開啟,接著“另存為“”csv格式,儲存下來,後面我們就用這個csv來執行線性迴歸。

開啟這個csv可以發現資料已經整理好,沒有非法資料,因此不需要做預處理。但是這些資料並沒有歸一化,也就是轉化為均值0,方差1的格式。也不用我們搞,後面scikit-learn線上性迴歸時會先幫我們把歸一化搞定。

好了,有了這個csv格式的資料,我們就可以大幹一場了。

3. 用pandas來讀取資料

我們先開啟ipython notebook,新建一個notebook。當然也可以直接在python的互動式命令列裡面輸入,不過還是推薦用notebook。下面的例子和輸出我都是在notebook裡面跑的。

先把要匯入的庫宣告瞭:

import matplotlib.pyplot as plt %matplotlib inline import numpy as np import pandas as pd from sklearn import datasets, linear_model

接著我們就可以用pandas讀取資料了:

# read_csv裡面的引數是csv在你電腦上的路徑,此處csv檔案放在notebook執行目錄下面的CCPP目錄裡 data = pd.read_csv('.\CCPP\ccpp.csv')

測試下讀取資料是否成功:

#讀取前五行資料,如果是最後五行,用data.tail() data.head()

執行結果應該如下,看到下面的資料,說明pandas讀取資料成功:

| AT | V | AP | RH | PE | |

|---|---|---|---|---|---|

| 0 | 8.34 | 40.77 | 1010.84 | 90.01 | 480.48 |

| 1 | 23.64 | 58.49 | 1011.40 | 74.20 | 445.75 |

| 2 | 29.74 | 56.90 | 1007.15 | 41.91 | 438.76 |

| 3 | 19.07 | 49.69 | 1007.22 | 76.79 | 453.09 |

| 4 | 11.80 | 40.66 | 1017.13 | 97.20 | 464.43 |

4. 準備執行演算法的資料

我們看看資料的維度:

data.shape

結果是(9568, 5)。說明我們有9568個樣本,每個樣本有5列。

現在我們開始準備樣本特徵X,我們用AT, V,AP和RH這4個列作為樣本特徵。

X = data[['AT', 'V', 'AP', 'RH']] X.head()

可以看到X的前五條輸出如下:

| AT | V | AP | RH | |

|---|---|---|---|---|

| 0 | 8.34 | 40.77 | 1010.84 | 90.01 |

| 1 | 23.64 | 58.49 | 1011.40 | 74.20 |

| 2 | 29.74 | 56.90 | 1007.15 | 41.91 |

| 3 | 19.07 | 49.69 | 1007.22 | 76.79 |

| 4 | 11.80 | 40.66 | 1017.13 | 97.20 |

接著我們準備樣本輸出y, 我們用PE作為樣本輸出。

y = data[['PE']] y.head()

可以看到y的前五條輸出如下:

| PE | |

|---|---|

| 0 | 480.48 |

| 1 | 445.75 |

| 2 | 438.76 |

| 3 | 453.09 |

| 4 | 464.43 |

5. 劃分訓練集和測試集

我們把X和y的樣本組合劃分成兩部分,一部分是訓練集,一部分是測試集,程式碼如下:

from sklearn.cross_validation import train_test_split X_train, X_test, y_train, y_test = train_test_split(X, y, random_state=1)

檢視下訓練集和測試集的維度:

print X_train.shape print y_train.shape print X_test.shape print y_test.shape

結果如下:

(7176, 4) (7176, 1) (2392, 4) (2392, 1)

可以看到75%的樣本資料被作為訓練集,25%的樣本被作為測試集。

6. 執行scikit-learn的線性模型

終於到了臨門一腳了,我們可以用scikit-learn的線性模型來擬合我們的問題了。scikit-learn的線性迴歸演算法使用的是最小二乘法來實現的。程式碼如下:

from sklearn.linear_model import LinearRegression linreg = LinearRegression() linreg.fit(X_train, y_train)

擬合完畢後,我們看看我們的需要的模型係數結果:

print linreg.intercept_ print linreg.coef_

輸出如下:

[ 447.06297099] [[-1.97376045 -0.23229086 0.0693515 -0.15806957]]

這樣我們就得到了在步驟1裡面需要求得的5個值。也就是說PE和其他4個變數的關係如下:

\(PE = 447.06297099 - 1.97376045*AT - 0.23229086*V + 0.0693515*AP -0.15806957*RH\)

7. 模型評價

我們需要評估我們的模型的好壞程度,對於線性迴歸來說,我們一般用均方差(Mean Squared Error, MSE)或者均方根差(Root Mean Squared Error, RMSE)在測試集上的表現來評價模型的好壞。

我們看看我們的模型的MSE和RMSE,程式碼如下:

#模型擬合測試集 y_pred = linreg.predict(X_test) from sklearn import metrics # 用scikit-learn計算MSE print "MSE:",metrics.mean_squared_error(y_test, y_pred) # 用scikit-learn計算RMSE print "RMSE:",np.sqrt(metrics.mean_squared_error(y_test, y_pred))

輸出如下:

MSE: 20.0804012021 RMSE: 4.48111606657

得到了MSE或者RMSE,如果我們用其他方法得到了不同的係數,需要選擇模型時,就用MSE小的時候對應的引數。

比如這次我們用AT, V,AP這3個列作為樣本特徵。不要RH, 輸出仍然是PE。程式碼如下:

X = data[['AT', 'V', 'AP']] y = data[['PE']] X_train, X_test, y_train, y_test = train_test_split(X, y, random_state=1) from sklearn.linear_model import LinearRegression linreg = LinearRegression() linreg.fit(X_train, y_train) #模型擬合測試集 y_pred = linreg.predict(X_test) from sklearn import metrics # 用scikit-learn計算MSE print "MSE:",metrics.mean_squared_error(y_test, y_pred) # 用scikit-learn計算RMSE print "RMSE:",np.sqrt(metrics.mean_squared_error(y_test, y_pred))

輸出如下:

MSE: 23.2089074701 RMSE: 4.81756239919

可以看出,去掉RH後,模型擬合的沒有加上RH的好,MSE變大了。

8. 交叉驗證

我們可以通過交叉驗證來持續優化模型,程式碼如下,我們採用10折交叉驗證,即cross_val_predict中的cv引數為10:

X = data[['AT', 'V', 'AP', 'RH']] y = data[['PE']] from sklearn.model_selection import cross_val_predict predicted = cross_val_predict(linreg, X, y, cv=10) # 用scikit-learn計算MSE print "MSE:",metrics.mean_squared_error(y, predicted) # 用scikit-learn計算RMSE print "RMSE:",np.sqrt(metrics.mean_squared_error(y, predicted))

輸出如下:

MSE: 20.7955974619 RMSE: 4.56021901469

可以看出,採用交叉驗證模型的MSE比第6節的大,主要原因是我們這裡是對所有折的樣本做測試集對應的預測值的MSE,而第6節僅僅對25%的測試集做了MSE。兩者的先決條件並不同。

9. 畫圖觀察結果

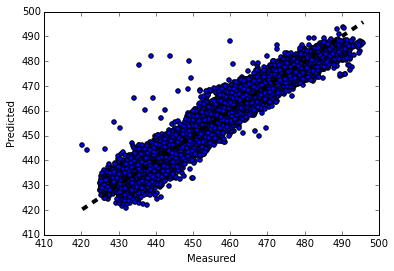

這裡畫圖真實值和預測值的變化關係,離中間的直線y=x直接越近的點代表預測損失越低。程式碼如下:

fig, ax = plt.subplots() ax.scatter(y, predicted) ax.plot([y.min(), y.max()], [y.min(), y.max()], 'k--', lw=4) ax.set_xlabel('Measured') ax.set_ylabel('Predicted') plt.show()

輸出的影象如下:

完整的jupyter-notebook程式碼參看我的Github。

以上就是用scikit-learn和pandas學習線性迴歸的過程,希望可以對初學者有所幫助。

(歡迎轉載,轉載請註明出處。歡迎溝通交流: liujianping-ok@163.com)