為什麼一些機器學習模型需要對資料進行歸一化?

http://www.cnblogs.com/LBSer/p/4440590.html

機器學習模型被網際網路行業廣泛應用,如排序(參見:排序學習實踐)、推薦、反作弊、定位(參見:基於樸素貝葉斯的定位演算法)等。一般做機器學習應用的時候大部分時間是花費在特徵處理上,其中很關鍵的一步就是對特徵資料進行歸一化,為什麼要歸一化呢?很多同學並未搞清楚,維基百科給出的解釋:1)歸一化後加快了梯度下降求最優解的速度;2)歸一化有可能提高精度。下面我簡單擴充套件解釋下這兩點。

1 歸一化為什麼能提高梯度下降法求解最優解的速度?

史丹佛機器學習視訊做了很好的解釋:https://class.coursera.org/ml-003/lecture/21

如下圖所示,藍色的圈圈圖代表的是兩個特徵的等高線。其中左圖兩個特徵X1和X2的區間相差非常大,X1區間是[0,2000],X2區間是[1,5],其所形成的等高線非常尖。當使用梯度下降法尋求最優解時,很有可能走“之字型”路線(垂直等高線走),從而導致需要迭代很多次才能收斂;

而右圖對兩個原始特徵進行了歸一化,其對應的等高線顯得很圓,在梯度下降進行求解時能較快的收斂。

因此如果機器學習模型使用梯度下降法求最優解時,歸一化往往非常有必要,否則很難收斂甚至不能收斂。

2 歸一化有可能提高精度

一些分類器需要計算樣本之間的距離(如歐氏距離),例如KNN。如果一個特徵值域範圍非常大,那麼距離計算就主要取決於這個特徵,從而與實際情況相悖(比如這時實際情況是值域範圍小的特徵更重要)。

3 歸一化的型別

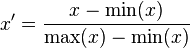

1)線性歸一化

這種歸一化方法比較適用在數值比較集中的情況。這種方法有個缺陷,如果max和min不穩定,很容易使得歸一化結果不穩定,使得後續使用效果也不穩定。實際使用中可以用經驗常量值來替代max和min。

2)標準差標準化

經過處理的資料符合標準正態分佈,即均值為0,標準差為1,其轉化函式為:

![]()

其中μ為所有樣本資料的均值,σ為所有樣本資料的標準差。

3)非線性歸一化

經常用在資料分化比較大的場景,有些數值很大,有些很小。通過一些數學函式,將原始值進行對映。該方法包括 log、指數,正切等。需要根據資料分佈的情況,決定非線性函式的曲線,比如log(V, 2)還是log(V, 10)等。