利用docker搭建spark hadoop workbench

目的

- 用docker實現所有服務

- 在spark-notebook中編寫Scala程式碼,實時提交到spark叢集中執行

- 在HDFS中儲存資料檔案,spark-notebook中直接讀取

元件

- Spark (Standalone模式, 1個master節點 + 可擴充套件的worker節點)

- Spark-notebook

- Hadoop name node

- Hadoop data node

- HDFS FileBrowser

實現

最初用了Big Data Europe的docker-spark-hadoop-workbench,但是docker 服務執行後在spark-notebook中執行程式碼會出現經典異常:

View

Code

View

Code

發現是因為spark-notebook和spark叢集使用的spark版本不一致. 於是fork了Big Data Europe的repo,在此基礎上做了一些修改,基於spark2.11-hadoop2.7實現了一個可用的workbench.

執行docker服務

docker-compose up -d

擴充套件spark worker節點

docker-compose scale spark-worker=3

測試服務

各個服務的URL如下:

Namenode: http://localhost:50070 Datanode: http://localhost:50075 Spark-master: http://localhost:8080 Spark-notebook: http://localhost:9001 Hue (HDFS Filebrowser): http://localhost:8088/home

以下是各個服務的執行截圖

HDFS Filebrower

Spark叢集

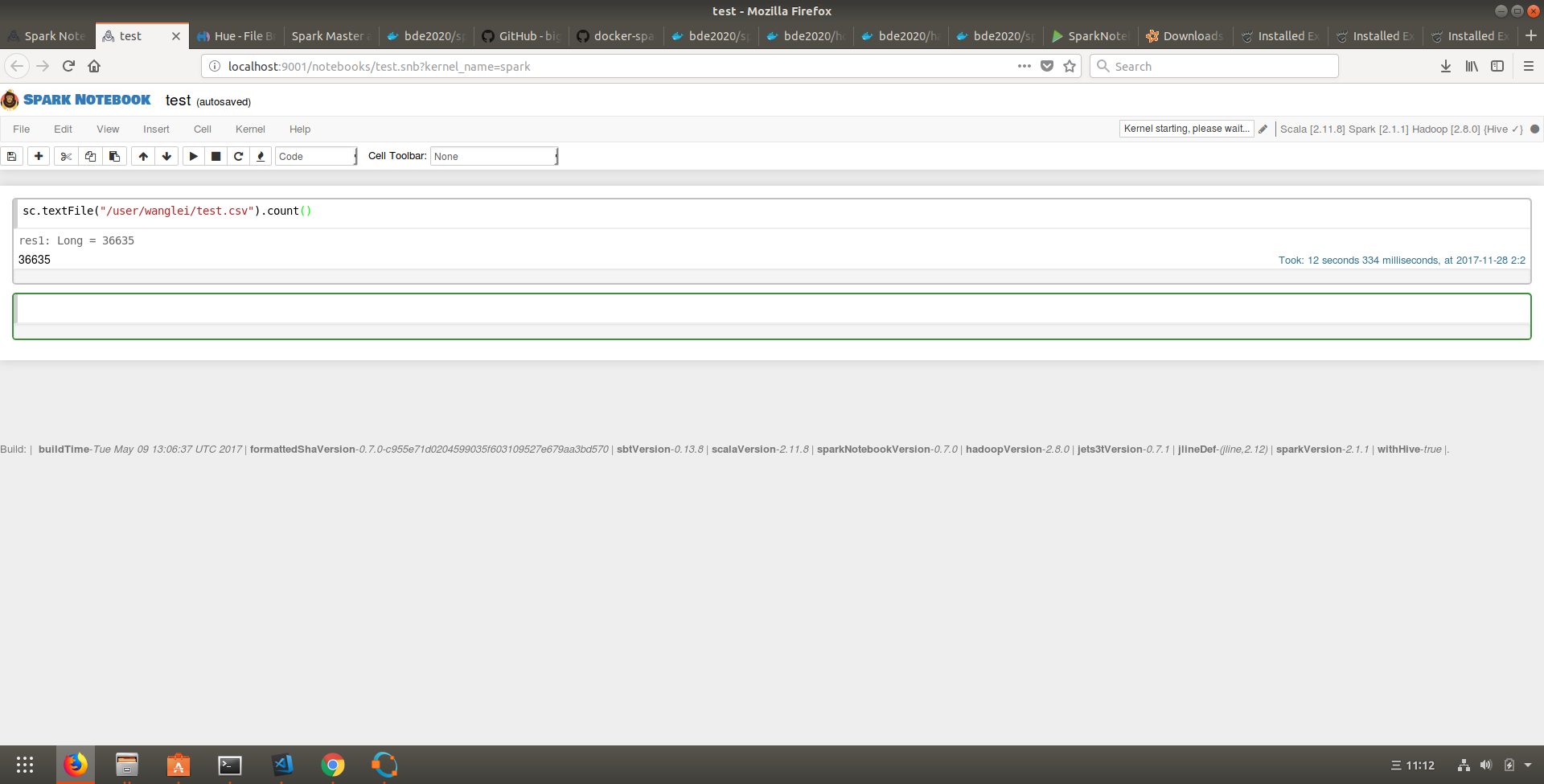

Spark-notebook

執行例子

1. 上傳csv檔案到HDFS FileBrowser,

2. Spark notebook新建一個notebook

3. 在新建的notebook裡操作HDFS的csv檔案

具體的步驟參考這裡

以下是spark-notebook執行的截圖:

程式碼連結

相關文章

- HADOOP SPARK 叢集環境搭建HadoopSpark

- 利用docker快速搭建hexo部落格DockerHexo

- Hadoop2.7.3+Hive2.1.1+Spark2.1.0環境搭建HadoopHiveSpark

- Hadoop 及Spark 分散式HA執行環境搭建HadoopSpark分散式

- 利用 Docker 一鍵搭建 LNMP 環境DockerLNMP

- 五行命令使用docker搭建hadoop叢集DockerHadoop

- docker下,極速搭建spark叢集(含hdfs叢集)DockerSpark

- 能否利用Hadoop搭建完整的雲端計算平臺Hadoop

- Spark在Hadoop叢集上的配置(spark-1.1.0-bin-hadoop2.4)SparkHadoop

- CentOS 7上搭建Spark 3.0.1 + Hadoop 3.2.1分散式叢集CentOSSparkHadoop分散式

- Hadoop與Spark關係HadoopSpark

- Hadoop Storm Spark比較HadoopORMSpark

- 【hadoop/Spark】相關命令HadoopSpark

- 利用TICK搭建Docker容器視覺化監控中心Docker視覺化

- 利用ELK搭建Docker容器化應用日誌中心Docker應用日誌

- Spark開發-spark環境搭建Spark

- hadoop:spark-project專案的hadoop配置HadoopSparkProject

- 搭建HadoopHadoop

- hadoop和spark的區別HadoopSpark

- Hadoop與Spark的比較HadoopSpark

- Spark只比Hadoop快19% ?SparkHadoop

- hadoop+spark偽分散式HadoopSpark分散式

- Docker系列——利用gogs搭建屬於自己的git服務DockerGoGit

- docker下的spark使用DockerSpark

- Spark學習進度-Spark環境搭建&Spark shellSpark

- spark環境搭建Spark

- 從 0 開始使用 Docker 快速搭建 Hadoop 叢集環境DockerHadoop

- CentOS 7上搭建Spark3.0.1+ Hadoop3.2.1分散式叢集CentOSSparkHadoop分散式

- 怎樣利用Spark Streaming和Hadoop實現近實時的會話連線SparkHadoop會話

- 雲主機centos7搭建基於docker的hadoop叢集CentOSDockerHadoop

- Hadoop/Spark 太重,esProc SPL 很輕HadoopSpark

- 搭建spark on yarn 叢集SparkYarn

- Spark on Yarn 環境搭建SparkYarn

- 大資料框架對比 - Hadoop、Spark、Storm、Samza、Spark、Flink大資料框架HadoopSparkORM

- 利用docker與shell指令碼進行懶人伺服器搭建Docker指令碼伺服器

- 如何掌握Spark和Hadoop的架構SparkHadoop架構

- Spark 和 Hadoop 是朋友不是敵人SparkHadoop

- Hadoop叢集搭建Hadoop